وظیفه فایل robots.txt محدود کردن دسترسی روبات های گوگل و سایر موتورهای جستجو به محتویات سایت شماست. با فایل robots.txt بیشتر آشنا شوید.

ستاره | سرویس تکنولوژی – فایل robots.txt چیست و نحوه استفاده از آن چگونه است؟ در ادامه پاسخ را بیابید.

وظیفه فایل robots.txt چیست؟

وظیفه فایل robots.txt محدود کردن دسترسی روباتهای گوگل و سایر موتورهای جستجو به محتویات سایت شماست. این روباتها بصورت کاملا اتوماتیک عمل کرده و قبل از ورود به هر سایت یا صفحهای از وجودفایل robots.txtبر روی آن و محدود نبودن دسترسی محتوا مطمئن میشوند. تمامی روباتهای استاندارد در اینترنت به این قوانین و محدودیتها احترام گذاشته و صفحات شما را بازدید و ایندکس نخواهند کرد ولی روباتهای اسپم توجهی به این فایل نخواهند داشت.

اگر تمایل به حفظ امنیت محتوایی خاص و پنهان کردن آن از دید روباتهای اینترنتی دارید بهتر است از پسورد گذاری صفحات استفاده کنید. در عمل استفاده از فایل robots.txt به شما این امکان را میدهد که صفحات سایت را تنها مختص کاربران اینترنتی طراحی کرده و ترسی از محتوای تکراری، وجود لینک های بسیار در آن صفحه و تاثیر منفی بر سئو سایت نداشته باشید. همچنین به شما این امکان را میدهد که صفحات بیارزش و کم محتوا را از دید موتورهای جستجو پنهان کنید تا زمان روباتها در سایت شما برای ایندکس کردن این صفحات هدر نرود.

شما تنها زمانیکه قصد محدود کردن روباتهای گوگل را داشته باشید از فایل robots.txt استفاده میکنید و اگر از نظر شما تمام صفحات سایت قابلیت و ارزش ایندکس شدن توسط گوگل را داشته باشند نیازی به این فایل نخواهید داشت. حتی قرار دادن یک فایل خالی با همین نام نیز لزومی ندارد. برای قرار دادن یک فایل robots.txt شما باید به هاست دسترسی داشته و آن را در ریشه اصلی کپی کنید. اگر به هر دلیل دسترسی شما به سرور محدود شده باشد میتوانید با قرار دادن تگهای متا در هدر صفحه دسترسی روبات به آن را محدود کنید.

برای جلوگیری از ورود تمامی روباتهای اینترنتی به صفحه از تگ

و برای محدود کردن روباتهای گوگل از تگ

استفاده کنید. با مشاهدهی این تگ در هدر یک صفحه گوگل، بطور کلی آن را از نتایج جستجوی خود خارج خواهد کرد.

آموزش ساخت فایل robots.txt

یک فایل ساده برای مدیریت روباتهای اینترنتی از دو قانون اصلی استفاده میکند که عبارتند از:

با ترکیب این دو دستور شما میتوانید قوانین مختلفی را برای دسترسی به صفحات داخلی سایت تعریف کنید. به عنوان مثال برای یک user-agent مشخص میتوان چندین آدرس را معرفی نمود و یا برعکس.

لیست تمامی روباتهای اینترنتی معتبر در دیتابیس “Web Robots Database” موجود است و شما میتوانید با قرار دادن نام هر یک بعنوان User-agent قوانین مشخصی برای آنها تعریف کنید و یا با استفاده از کاراکتر * به جای نام در فایل robots.txt یک قانون را برای همه روباتها اعمال کنید؛ مانند:

* :User-agent

Disallow: /folder1/

موتور جستجوی گوگل چندیدن نوع روبات مخصوص بخود دارد که معروفترین آنها با نام Googlebot شناخته میشود و وظیفه بررسی و ایندکس صفحات وب را برعهده دارد. روبات Gogglebot-image نیز مسئول بررسی تصاویر سایتها و ایندکس کردن آنها میباشد.

User-Agent: Googlebot

Disallow: /folder2/

Disallow: /

برای عدم دسترسی به یک فولدر یا دسته از سایت نام آن را وارد کنید.

Disallow: /blog/

برای اعمال محدودیت روی یک صفحه خاص آدرس دقیق آن را بدون نام سایت وارد کنید.

Disallow: /blog/keyword-planner/

برای محدود کردن یک تصویر بر روی سایت آدرس آن را به همراه User-agent مربوط به آن وارد کنید.

و برای مخفی کردن تمام تصاویر موجود بر روی سایت از دید موتورهای جستجو از دستور زیر استفاده کنید.

همچنین شما میتوانید یک نوع فایل مشخص را از دید موتورهای جستجو مخفی نگه دارید، به عنوان مثال برای تصاویری با فرمت gif

توجه داشته باشید که فایل robots.txt نسبت به بزرگ و کوچک بودن حروف انگلیسی حساس بوده و آدرس صفحات باید به دقت وارد شوند. پس از ساخت فایل مورد نظر خود و ذخیره آن در فرمت txt آن را بر روی سرور و در ریشه اصلی کپی کنید. قوانین اعمال شده برای روباتهایی هستند که از این پس به سایت شما وارد میشوند حذف صفحاتی که در گذشته ایندکس شدهاند از دیتابیس گوگل نیازمند گذشت زمان خواهد بود.

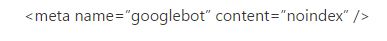

آزمایش Robots.txt در بخش Blocked URLs وبمستر

وبمستر گوگل قسمت مشخصی را برای نمایش صفحاتی از سایت شما که توسط robots.txt دسترسی روبات به آنها محدود شده، در نظر گرفته است. این صفحه با نام Blocked URLs و به عنوان زیر مجموعهای از بخش Crawl تعریف شده است. برای اطمینان از عملکرد صحیح فایل robots.txt به بخش Blocked URLs در اکانت وبمستر خود مراجعه کرده و مانند تصویر زیر در بخش اول محتویات فایل را کپی کنید. در بخش دوم آدرس صفحاتی که قصد دارید میزان محدودیت روباتهای گوگل در دسترسی به آنها را بسنجید وارد کنید. (در هر خط یک آدرس). در بخش انتهایی شما میتوانید یک نوع از روباتهای گوگل را علاوه بر روبات اصلی که وظیفه ایندکس صفحات را برعهده دارد انتخاب کنید.

نمایی از صفحه Blocked urls در وبمستر گوگل

با فشردن دکمه Test نتایج آزمون و میزان دسترسی روباتها به هریک از این آدرسها به شما نمایش داده خواهد شد.

نمونهای از نتایج آزمایش فایل Robots.txt

نحوه انتخاب صفحاتی که در فایل robots.txt معرفی میشوند و پنهان کردن آنها از دید موتورهای جستجو وابستگی مستقیم با سیاستهای شما در انتشار محتوا و سئو سایت خواهد داشت. قبل از انجام تغییرات اساسی در این فایل حتما با متخصصان سئو مشورت کرده و کدهای وارد شده را چندین بار آزمون و بازنویسی نمایید.

مطالب زیر را نیز در ستاره بخوانید:

هنوز دیدگاهی ثبت نشده است.